ورود به عصر دلهرهآور

رهبران امنیت ملی به ندرت میتوانند انتخاب کنند که به چه چیزی و چقدر اهمیت بدهند. آنها اغلب تابع شرایطی هستند که خارج از کنترل آنهاست. حملات 11 سپتامبر، برنامه دولت جورج. دبلیو بوش برای کاهش تعهدات و مسوولیتهای جهانی ایالات متحده را معکوس کرد.

انقلاب ها در سراسر جهان عرب، درست زمانی که باراک اوباما، رئیس جمهور آمریکا، تلاش می کرد آمریکا را از خاورمیانه بیرون بکشد، او را به این منطقه بازگرداند. حمله روسیه به اوکراین، هدف دولت بایدن برای ایجاد روابط «پایدار و قابل پیش بینی» با مسکو را نقش بر آب کرد تا بتواند بر رقابت استراتژیک با چین تمرکز کند.

به نوشته مجله فارن افرز، سیاستگذاران میتوانستند بسیاری از نیروها و روندهای اساسی محرک این رویدادهای شکل دهنده دستور کار را پیش بینی کنند. با این حال، در بیشتر موارد، آنها در برنامه ریزی برای چالش برانگیزترین نمودهای این نیروها، به اینکه به کجا منتهی میشوند، شکست خوردند.

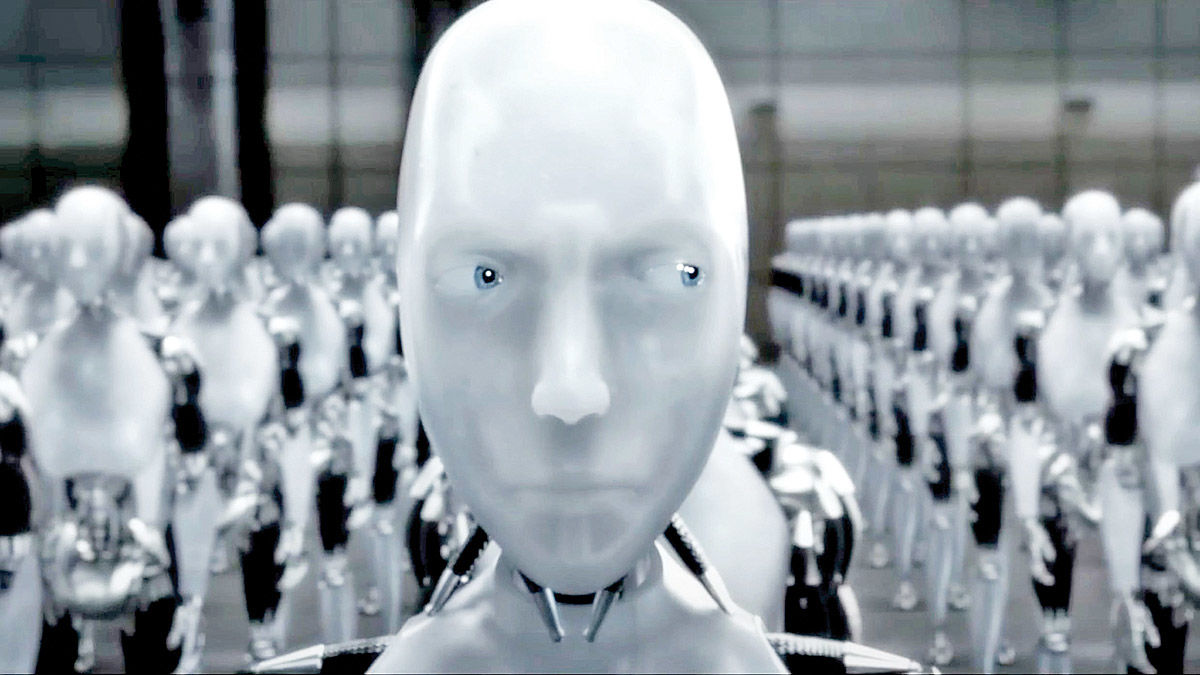

آنها مجبور بودند برای پاسخ به رویدادهای در حال وقوع، استراتژی های خود را از نو مفهوم سازی و تنظیم کنند. پیشرفت سریع هوش مصنوعی - و ظهور احتمالی هوش مصنوعی جنرال - نویدبخش اختلالی حتی بزرگتر برای سیاستگذاران است. نشانه های یک تغییر قدرتمند در راه است که همه جا دیده میشود. پکن و واشنگتن رهبری جهانی هوش مصنوعی را به یک ضرورت استراتژیک تبدیل کرده اند و شرکتهای پیشروی آمریکایی و چینی برای دستیابی به هوش مصنوعی عمومی یا جنرال (AGI) در حال رقابت هستند.

پوشش خبری تقریباً روزانه شامل اعلامیه های مربوط به پیشرفتهای فنی، بحث در مورد از دست دادن شغل ناشی از هوش مصنوعی و ترس از خطرات فاجعه بار جهانی مانند مهندسی یک بیماری همه گیر مرگبار با استفاده از هوش مصنوعی است. هیچ راهی برای دانستن قطعی مسیر دقیق توسعه هوش مصنوعی یا چگونگی تغییر امنیت ملی توسط آن وجود ندارد. بنابراین، سیاستگذاران باید با فروتنی و احتیاط، شایستگی استراتژی های هوش مصنوعی رقیب را ارزیابی و مورد بحث قرار دهند. چه در مورد چشم انداز هوش مصنوعی خوش بین باشیم و چه بدبین، رهبران امنیت ملی باید آماده باشند تا برنامه های استراتژیک خود را بر تصمیمگیرندگان تحمیل کنند.

واشنگتن باید برای بده بستان های سیاسی بالقوه و تغییرات ژئوپلیتیک آماده شود و گام های عملی را که میتواند امروز برای کاهش خطرات و تقویت رقابت پذیری ایالات متحده بردارد، شناسایی کند. برخی از ایده ها و ابتکاراتی که امروز ممکن است غیرممکن یا غیرضروری به نظر برسند، با نگاهی به گذشته، فوری و بدیهی به نظر خواهند رسید.

به دنبال چشم انداز جدید

هیچ تعریف استاندارد و مشترکی از هوش مصنوعی عمومی یا اجماعی در مورد اینکه آیا، چه زمانی یا چگونه ممکن است ظهور کند، وجود ندارد. مدل های هوش مصنوعی پیشروی امروزی، در حال حاضر بهطور فزاینده ای قادر به انجام تعداد و پیچیدگی بیشتری از وظایف شناختی نسبت به ماهرترین و مجهزترین انسان ها هستند.

از زمان راه اندازی چت جی پی تی در سال 2022، قدرت هوش مصنوعی به طرز چشمگیری افزایش یافته است. منطقی است که فرض کنیم این مدل ها در سال های آینده قدرتمندتر، مستقل تر و فراگیرتر خواهند شد. با این وجود، بعید است که دوران هوش مصنوعی عمومی (AGI) مانند دوران هسته ای که با نخستین آزمایش سلاح های هسته ای همراه بود، با یک لحظه تکان دهنده خود را نشان دهد.

شرایط اقتصادی و فناوری نیز به اندازه گذشته برای برنامه ریزان آمریکایی مطلوب نیست. برای مثال، در دوران هسته ای، دولت ایالات متحده فناوری جدید را کنترل می کرد و برنامه ریزان دو دهه فرصت داشتند تا قبل از ظهور یک رقیب هسته ای، چارچوب های سیاستی را تدوین کنند.

در مقابل، برنامه ریزان امروزی، اختیار و زمان کمتری برای سازگاری دارند. چین در حال حاضر در فناوری تقریباً هم رده است، تعداد انگشت شماری از شرکتهای خصوصی، این «توسعه و پیشبرد» را هدایت می کنند و هوش مصنوعی یک فناوری همه منظوره است که تقریباً در هر بخش از اقتصاد و جامعه در حال گسترش است.

در این محیط به سرعت در حال تغییر، رهبران امنیت ملی باید منابع برنامه ریزی کمیاب را به رویدادهای محتمل اما بهشدت چالش برانگیز اختصاص دهند. این نوع رویدادها صرفاً اختلال در وضع موجود نیستند، بلکه نشانه هایی از آینده های جایگزین نیز هستند. برای مثال، فرض کنید یک شرکت آمریکایی ادعا می کند که به جهش تکنولوژیکی متحول کننده ای در حوزه هوش مصنوعی عمومی (AGI) دست یافته است.

رهبران باید تصمیم بگیرند که اگر این شرکت درخواست کند که به عنوان یک «دارایی امنیت ملی» با آن برخورد شود، دولت ایالات متحده چگونه باید واکنش نشان دهد. سیاستگذارانی که با این سناریوها دست و پنجه نرم می کنند، باید ارزیابی های رقیب و گاه متناقض را متعادل کنند که منجر به قضاوت های متفاوتی در مورد میزان ریسک قابل پذیرش و اولویت بندی نگرانی ها خواهد شد.

بدون قابلیت های تحلیلی قوی و مستقل، دولت ایالات متحده ممکن است برای تعیین اعتبار ادعاهای شرکتها با مشکل مواجه شود. رهبران امنیت ملی همچنین باید در نظر بگیرند که آیا پیشرفت تکنولوژیک جدید میتواند برای چین مزیت استراتژیک ایجاد کند یا خیر. اگر آنها نگران باشند که هوش مصنوعی عمومی به پکن این امکان را بدهد که آسیب پذیری های زیرساخت های حیاتی ایالات متحده را سریع تر از آنچه دفاع سایبری میتواند آنها را وصله کند، شناسایی و بهره برداری کند، ممکن است اقداماتی را تجویز کنند که میتواند خطر درگیری ژئوپلیتیک را افزایش دهد.

از سوی دیگر، اگر رهبران امنیت ملی بیشتر نگران این باشند که بازیگران غیردولتی یا تروریست ها میتوانند از این فناوری جدید برای ایجاد سلاح های بیولوژیک فاجعه بار استفاده کنند، ممکن است ترجیح دهند برای جلوگیری از گسترش یک تهدید جهانی بزرگتر، با پکن همکاری کنند. افزایش آمادگی برای سناریوهای هوش مصنوعی عمومی (AGI) نیازمند درک بهتر از اکوسیستم هوش مصنوعی در داخل و خارج از کشور است. سازمانهای دولتی باید با نحوه توسعه هوش مصنوعی همگام باشند تا مشخص کنند که پیشرفتهای جدید در کجا محتمل تر است.

این امر خطر غافلگیری استراتژیک را کاهش میدهد و به انتخاب های سیاستی در مورد اولویت بندی تنگناها و بهره برداری از آسیب پذیری ها برای کند کردن بالقوه پیشرفت چین کمک می کند. سیاستگذاران همچنین باید راه هایی را برای همکاری با بخش خصوصی و سایر کشورها بررسی کنند. یک مشارکت مقیاس پذیر، پویا و دوطرفه بین بخش خصوصی و دولتی برای پاسخ استراتژیک به چالش های فعلی هوش مصنوعی بسیار مهم است و این امر در دنیای هوش مصنوعی عمومی (AGI) حتی بیشتر صدق خواهد کرد. سوءظن متقابل بین دولت و بخش خصوصی میتواند هرگونه واکنش به بحران را فلج کند.

در همین حال، رهبران باید سیاستهایی را برای به اشتراک گذاشتن اطلاعات حساس و اختصاصی در مورد تحولات هوش مصنوعی پیشرو با شرکا و متحدان تدوین کنند. بدون چنین سیاستهایی، ایجاد ائتلاف بینالمللی مورد نیاز برای پاسخ به بحران ناشی از هوش مصنوعی، کاهش ریسک جهانی و پاسخگو نگه داشتن کشورها و شرکتها در قبال رفتارهای غیرمسوولانه، چالش برانگیز خواهد بود.

هوش مصنوعی خصمانه

هوش مصنوعی عمومی نه تنها پویایی های ژئوپلیتیک موجود را پیچیده تر خواهد کرد، بلکه چالش های جدیدی در امنیت ملی نیز ایجاد خواهد کرد. یک حمله سایبری بی سابقه مبتنی بر هوش مصنوعی را تصور کنید که موسسات مالی، شرکتهای خصوصی و سازمانهای دولتی را ویران کند و سیستم های فیزیکی را از زیرساخت های حیاتی گرفته تا روباتیک صنعتی از کار بیندازد. در دنیای امروز، تعیین اینکه چه کسی مسوول جنگ سایبری است، خود به خود یک کار چالش برانگیز و زمان بر است. هر تعداد از بازیگران دولتی و غیردولتی، هم ابزار و هم انگیزه های لازم برای انجام حملات بی ثبات کننده را دارند.

با این حال، در جهانی با هوش مصنوعی به طور فزاینده ای پیشرفته، وضعیت حتی پیچیده تر خواهد شد. سیاستگذاران نه تنها باید این احتمال را در نظر بگیرند که عملیاتی در این مقیاس میتواند مقدمه ای برای یک لشکرکشی نظامی باشد، بلکه باید این احتمال را نیز در نظر بگیرند که این کار ممکن است کار یک عامل هوش مصنوعی خودمختار و خودتکثیرشونده باشد.

برنامه ریزی برای این سناریو مستلزم ارزیابی چگونگی توانایی های امروز در مواجهه با چالش های فردا است. دولتها نمیتوانند برای ارزیابی سریع و مطمئن یک تهدید، به ابزارها و تکنیک های امروزی تکیه کنند، چه برسد به اینکه اقدامات متقابل مربوطه را به کار گیرند. با توجه به ظرفیت اثبات شده سیستم های هوش مصنوعی در فریب و پنهان کاری، سیستم های فعلی ممکن است قادر به تشخیص این نباشند که آیا یک عامل هوش مصنوعی به تنهایی عمل می کند یا به دستور دشمن. برنامه ریزان باید راه های جدیدی برای ارزیابی انگیزه های آن و چگونگی جلوگیری از تشدید تنش پیدا کنند.

آماده شدن برای بدترین حالت مستلزم ارزیابی مجدد گام های «منتسب به ندانم گرایی فعلی» برای تقویت دفاع سایبری، ایزوله کردن مراکز داده بالقوه در معرض خطر و جلوگیری از ناتوانی پهپادها یا وسایل نقلیه متصل است. برنامه ریزان باید ارزیابی کنند که آیا پروتکل های فعلی نظامی و تداوم عملیات میتوانند تهدیدات هوش مصنوعی متخاصم را مدیریت کنند یا خیر.

بی اعتمادی عمومی به دولت و شرکتهای فناوری، اطمینان بخشی به جمعیت نگران را در صورت انتشار اطلاعات نادرست ناشی از هوش مصنوعی، دشوارتر خواهد کرد. با توجه به اینکه یک عامل هوش مصنوعی مستقل احتمالا به مرزهای ملی احترام نمیگذارد، آمادگی های کافی شامل ایجاد کانال هایی با شرکا و دشمنان به طور یکسان برای هماهنگی یک واکنش بینالمللی موثر خواهد بود.

اینکه رهبران چگونه تاثیرات خارجی یک تهدید قریب الوقوع را تشخیص میدهند، نحوه واکنش آنها را شکل میدهد. در صورت وقوع حمله سایبری، سیاستگذاران در لحظه باید تصمیم بگیرند که آیا خاموش کردن هدفمند سیستم های سایبری - فیزیکی آسیب پذیر و مراکز داده آسیب پذیر را دنبال کنند یا - از ترس احتمال تکرار سریع - خاموشی جامع تری را اعمال کنند که بتواند از تشدید حملات جلوگیری کند اما این اقدام ممکن است در عین حال مانع عملکرد اقتصاد دیجیتال و سیستم هایی شود که فرودگاه ها و نیروگاه ها به آنها متکی هستند. این سناریوی از دست دادن کنترل، اهمیت شفاف سازی اختیارات قانونی و تدوین برنامه های واکنش به حادثه را برجسته می کند.

به طور گسترده تر، این امر فوریت ایجاد سیاستها و استراتژی های فنی برای رسیدگی به چگونگی تمایل مدل های پیشرفته به سوء رفتار را تقویت می کند. برنامه ریزی حداقل باید شامل چهار نوع اقدام باشد. اول، باید اقدامات «بدون پشیمانی» را تعیین کند که سیاستگذاران و بازیگران بخش خصوصی بتوانند امروز برای واکنش به رویدادها از موضع قدرت انجام دهند.

دوم، باید دستورالعمل های «شکستن شیشه» را برای موارد اضطراری آینده ایجاد کند که بتوانند با ظهور تهدیدها، فرصت ها و مفاهیم جدید، به طور مداوم به روزرسانی شوند. سوم، باید روی قابلیت هایی سرمایه گذاری کند که در سناریوهای متعدد، حیاتی به نظر می رسند. در نهایت، باید شاخص ها و هشدارهای اولیه شکست استراتژیک را در اولویت قرار دهد و شرایطی را برای اصلاح مسیر ایجاد کند.

جایی برای عادت های قدیمی نیست

برنامه ریزی برای تاثیرات هوش مصنوعی عمومی (AGI) بر امنیت ملی باید از همین حالا آغاز شود. در جهانی که به طور فزاینده ای رقابتی و در حال اشتعال است و با یک محیط داخلی از نظر اقتصادی شکننده و از نظر سیاسی قطبی شده، نباید غافلگیر شد.

اگرچه ممکن است که هوش مصنوعی در نهایت به یک «فناوری عادی» تبدیل شود - فناوری ای مانند اینترنت یا برق که جهان را متحول می کند اما سرعت پذیرش آن محدودیت های طبیعی دارد که دولتها و جوامع میتوانند آن را کنترل کنند - اما فرض اینکه آماده شدن برای یک اختلال بزرگ اشتباه است، احمقانه خواهد بود. برنامه ریزی برای چالش های دشوارتر میتواند به رهبران امنیت ملی کمک کند تا مسائل استراتژیک اصلی را شناسایی کرده و ابزارهای واکنشی بسازند که در شرایط نه چندان سخت نیز به همان اندازه مفید باشند.

همچنین عاقلانه نیست که فرض کنیم چنین برنامه ریزی ای باعث ایجاد غرایز و مسیرهای سیاسی میشود که خطرات را تشدید می کند یا پیشرفت هوش مصنوعی را کُند می کند. برای مثال، در عصر هسته ای، برنامه ریزی برای تروریسم هسته ای بالقوه، الهام بخش ابتکارات جهانی برای ایمن سازی مواد شکافت پذیر مورد نیاز برای ساخت سلاح های هسته ای شد که در نهایت جهان را امن تر کرد.

همچنین خطرناک خواهد بود که احتمال هوش مصنوعی عمومی را مانند هر «سناریوی عادی» در دنیای امنیت ملی در نظر بگیریم. تخصص و تسلط فنی در سراسر دولت محدود و نابرابر است و بازیگران نهادی که در پاسخ به هر سناریویی دخیل خواهند بود، بسیار فراتر از آژانس های امنیت ملی سنتی هستند. احتمالاً بیشتر سناریوها همزمان در خارج از کشور و در داخل کشور رخ میدهند.

هرگونه واکنشی بهشدت به انتخاب ها و تصمیمات بازیگران خارج از دولت، از جمله شرکتها و سازمانهای جامعه مدنی، متکی خواهد بود که در اتاق وضعیت کاخ سفید جایی ندارند و ممکن است امنیت ملی را در اولویت قرار ندهند. به همین ترتیب، برنامه ریزی را نمیتوان به آینده پژوهان و متخصصان فنی که به پناهگاهی دوردست فرستاده میشوند تا ماه ها در انزوا برنامه های دقیقی را تدوین کنند، واگذار کرد. آماده شدن برای آینده با هوش مصنوعی عمومی باید به طور مداوم بر مباحث استراتژیک امروز تاثیر بگذارد.

بحثهای فعالی در مورد مزایای استراتژی های مختلف برای پیروزی در رقابت هوش مصنوعی و در عین حال جلوگیری از فاجعه وجود دارد، اما بحث کمتری در مورد چگونگی تغییر شکل چشم انداز بینالمللی، توزیع قدرت جهانی و اتحادهای ژئوپلیتیک توسط هوش مصنوعی عمومی (AGI) صورت گرفته است. در جهانی که بهطور فزاینده ای چندقطبی میشود، بازیگران نوظهور، هوش مصنوعی پیشرفته - و اینکه چگونه ایالات متحده و چین فناوری هوش مصنوعی و معماری دیجیتال زیربنایی آن را منتشر می کنند - را کلید آرمان های ملی خود می دانند. برنامه ریزی اولیه، تمرین های میدانی با متحدان و شرکا و گفتوگوی پایدار با کشورهایی که میخواهند از ریسک های دیپلماتیک خود بکاهند، تضمین می کند که انتخاب های استراتژیک برای هر دو طرف سودمند باشند.

هر استراتژی هوش مصنوعی که نتواند جهان چندقطبی و یک اکوسیستم فناوری جهانی توزیع شده تر را در نظر بگیرد، شکست خواهد خورد. هر استراتژی امنیت ملی که نتواند با اثرات بالقوه دگرگون کننده هوش مصنوعی عمومی (AGI) دست و پنجه نرم کند، بی ربط خواهد شد. رهبران امنیت ملی نمیتوانند بحران های خود را انتخاب کنند.

با این حال، آنها میتوانند انتخاب کنند که برای چه چیزی برنامه ریزی کنند و منابع را برای آمادگی در برابر چالش های آینده به کجا اختصاص دهند. برنامه ریزی برای هوش مصنوعی عمومی (AGI) غرق شدن در داستانهای علمی تخیلی یا حواس پرتی از مشکلات و فرصت های موجود نیست. این یک روش مسوولانه برای آماده شدن در مقابل وقوع مجموعه ای جدید از چالش های امنیت ملی در جهانی بهشدت متحول است.